Bên cạnh sự bùng nổ AI: Xuất hiện hàng chục ứng dụng tìm và phát hiện các nội dung do AI tạo ra

VietTimes – Hàng chục công ty đang cung cấp các ứng dụng và dịch vụ nhằm phát hiện một bức ảnh, văn bản hoặc video có phải do AI tạo ra hay không.

|

|

Với công nghệ AI, người ta có thể gắn mặt người này vào thân hình người khác, sống động như thật |

Khi mà công nghệ Trí tuệ nhân tạo (AI) đang ngày càng phát triển, đã có hàng chục công ty được tạo ra với mục đích cung cấp các dịch vụ kiểm định ảnh, văn bản, video để xem những sản phẩm này là do con người hay máy móc tạo ra.

Andrey Doronichev, một doanh nhân người Nga đã vô cùng ngạc nhiên khi xem một video trên mạng xã hội cho thấy Tổng thống Ukraine đầu hàng Nga.

Đoạn video nhanh chóng được xác định là sai sự thật và nó được tạo ra bởi một phần mềm AI có tên là deepfake. Đối với ông Doronichev, những thông tin sai lệch như vậy là hết sức nguy hiểm. Năm nay, nỗi sợ hãi của ông Doronichev đã đến gần hơn với thực tế, khi các công ty bắt đầu cạnh tranh để tăng cường áp dụng trí tuệ nhân tạo bất chấp sự nguy hiểm mà nó có thể gây ra.

AI hiện có sẵn cho bất kỳ ai và nó ngày càng có khả năng đánh lừa mọi người bằng văn bản, âm thanh, hình ảnh và video. Nguy cơ về sự cả tin của xã hội đã làm dấy lên mối lo ngại về thông tin sai lệch, mất việc làm, phân biệt đối xử, quyền riêng tư và tình trạng lạc hậu trên diện rộng.

Ông Doronichev, nhà đầu tư cho một ứng dụng hoán đổi khuôn mặt có tên Reface, cho biết: “Tính xác thực của nội dung sẽ trở thành một vấn đề lớn đối với toàn xã hội. “Chúng ta đang bước vào thời đại của hàng giả giá rẻ". Sở dĩ ông Doronichev nói như vậy là vì việc sản xuất nội dung giả mạo không tốn nhiều chi phí nên nó có thể được thực hiện trên quy mô lớn.

Thị trường AI dự kiến sẽ vượt mức 109 tỉ USD vào năm 2030, tăng trưởng trung bình 35,6% mỗi năm cho đến lúc đó, theo công ty nghiên cứu thị trường Grand View Research.

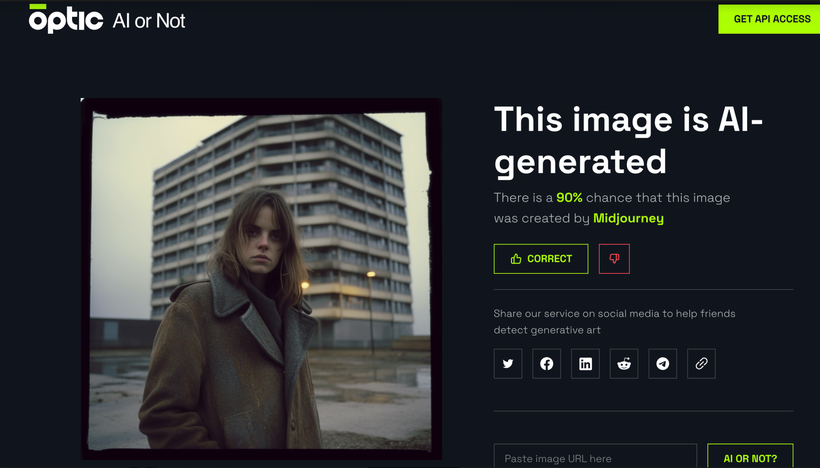

Đối với những doanh nhân như ông Doronichev, sự phổ biến của các nội dung AI giả mạo cũng trở thành một cơ hội kinh doanh. Hơn một chục công ty hiện cung cấp các công cụ để xác định xem nội dung nào đó có được tạo ra bằng AI hay không, với những cái tên như Sensity AI (phát hiện deepfake), FictitiousAI và OriginalityAI (phát hiện đạo văn).

Nhiều tháng sau khi được tạo ra bởi một sinh viên Đại học Princeton, GPTZero tuyên bố rằng hơn một triệu người đã sử dụng chương trình này để đọc văn bản do máy tính tạo ra.

Copyleaks đã huy động được 7,75 triệu USD vào năm ngoái một phần để mở rộng dịch vụ chống đạo văn cho các trường trung học và đại học nhằm phát hiện sự can thiệp của AI trong các bài kiểm tra của sinh viên. Sentinel, người sáng lập công ty chuyên về an ninh mạng và chiến tranh thông tin cho Hải quân Hoàng gia Anh và Tổ chức Hiệp ước Bắc Đại Tây Dương, đã đầu tư 1,5 triệu USD vào năm 2020 để kết hợp với một trong những kỹ sư sáng lập của Skype nhằm giúp người dùng chống lại deepfake và các phần mềm độc hại khác.

Các công ty công nghệ lớn cũng tham gia: FakeCatcher của Intel tuyên bố có thể xác định các video deepfake với độ chính xác 96% bằng cách phân tích pixel để tìm các dấu hiệu như các mạch máu xuất hiện trên mặt con người.

Video giả mạo cựu Tổng thống Obama (bên phải) giống hệt người thật

Cơ quan Dự án Nghiên cứu Tiên tiến Quốc phòng Mỹ có kế hoạch chi gần 30 triệu USD trong năm nay để khởi chạy Semantic Forensics, một chương trình phát triển các thuật toán để tự động phát hiện deepfake và xác định xem chúng có độc hại hay không.

Ngay cả OpenAI, công ty đã tạo nên sự bùng nổ của AI nhờ vào sản phẩm ChatGPT, cũng đang làm việc trên các dịch vụ phát hiện AI. Công ty có trụ sở tại San Francisco này đã ra mắt một công cụ miễn phí vào tháng 1 để giúp phân biệt giữa văn bản do con người soạn thảo và văn bản do trí tuệ nhân tạo viết.

OpenAI nhấn mạnh rằng mặc dù công cụ này là một cải tiến, nhưng nó vẫn “không hoàn toàn đáng tin cậy”. Công cụ này đã xác định chính xác 26% văn bản được tạo ra bởi AI nhưng đã xác định sai 9% văn bản do con người tạo ra".

Công cụ OpenAI có nhiều lỗi phổ biến trong quá trình phát hiện văn bản do AI tạo ra. Nó gặp khó khăn với các văn bản ngắn và văn bản không phải bằng tiếng Anh. Trong môi trường giáo dục, các công cụ phát hiện đạo văn như TurnItIn đã bị cáo buộc phân loại không chính xác các bài luận do học sinh viết khi lầm tưởng là do chatbot tạo ra.

Các công cụ phát hiện vốn đã tụt hậu so với công nghệ chung mà chúng đang cố gắng phát hiện. Vào thời điểm hệ thống "phòng thủ" có thể nhận ra hoạt động của một chatbot hoặc trình tạo hình ảnh mới, như Google Bard hoặc Midjourney, thì các nhà phát triển đã nghĩ ra một phiên bản mới có thể tránh được sự "phòng thủ" đó.

Các chuyên gia cho rằng các video tổng hợp được tạo ra bởi AI rất lộn xộn và dễ nhận dạng, nhưng việc sao chép âm thanh và tạo hình ảnh đều rất tiên tiến. Việc phân biệt sẽ yêu cầu các kỹ thuật phức tạp như tìm kiếm hình ảnh ngược và theo dõi địa chỉ IP.

Content Authenticity Initiative, một tập đoàn gồm 1.000 công ty và tổ chức, đang cố gắng làm cho công nghệ AI trở nên "rõ ràng" ngay từ đầu. Adobe, một trong những công ty thuộc Content Authenticity Initiative cho biết vào tuần trước rằng công nghệ tạo ra Firefly của họ sẽ được tích hợp vào Google Bard, nơi nó sẽ đính kèm "nhãn phân biệt" vào nội dung mà nó tạo ra, bao gồm ngày tháng tạo hình ảnh và các công cụ kỹ thuật số được sử dụng để tạo ra hình ảnh hoặc video đó.

Jeff Sakasegawa, kiến trúc sư về độ tin cậy và an toàn tại Persona, một công ty giúp xác minh danh tính người dùng, cho biết những thách thức do trí tuệ nhân tạo đặt ra mới chỉ bắt đầu.

Theo NYT